Python – мощный и универсальный язык программирования, который широко применяется во многих сферах. Использование Python для захвата содержимого внутри тегов HTML является очень полезной задачей, особенно для веб-разработчиков. Благодаря некоторым мощным библиотекам Python, таким как Beautiful Soup и Requests, эту задачу можно легко решить.

Beautiful Soup – это библиотека Python, предназначенная для разбора HTML и XML документов. Она позволяет простым и эффективным способом извлекать информацию, находить нужные элементы на веб-странице и упрощать манипуляции с данными. Благодаря широкому функционалу и интуитивно понятному синтаксису, Beautiful Soup является одним из наиболее популярных инструментов для парсинга HTML с использованием Python.

Requests – это простая и элегантная библиотека Python для отправки HTTP-запросов. С её помощью можно легко получить содержимое веб-страницы, используя различные типы запросов (GET, POST и т. д.). Преимущество этой библиотеки заключается в простом и понятном интерфейсе, который упрощает взаимодействие с веб-серверами и обработку полученных данных.

- Как использовать Python для извлечения внутреннего содержимого HTML

- Зачем нужна разработка данных

- Извлечение информации из HTML

- Автоматизированная обработка больших объемов данных

- Как использовать Python для извлечения данных

- Импорт библиотеки BeautifulSoup

- Парсинг HTML-страницы с использованием BeautifulSoup

- Примеры использования Python для парсинга HTML

Как использовать Python для извлечения внутреннего содержимого HTML

Для начала, вам понадобится установить библиотеку BeautifulSoup, которая позволяет с легкостью парсить HTML и XML документы. Вы можете установить эту библиотеку с помощью пакетного менеджера pip:

pip install beautifulsoup4

После установки библиотеки, вы можете импортировать ее в свой скрипт:

from bs4 import BeautifulSoup

Затем вам понадобится получить HTML код веб-страницы. Для этого вы можете использовать библиотеку requests:

import requests

# Получаем HTML код веб-страницы

response = requests.get('https://example.com')

html = response.text

Теперь, когда у вас есть HTML код страницы и вы импортировали библиотеку BeautifulSoup, вы можете начать извлекать внутреннее содержимое HTML. Для этого вам потребуется знать структуру HTML-документа и расположение нужной информации. Вы можете использовать различные методы и фильтры BeautifulSoup для поиска нужных элементов HTML:

# Создаем объект BeautifulSoup

soup = BeautifulSoup(html, 'html.parser')

# Находим все теги <p> внутри тега <div id="content">

paragraphs = soup.find('div', id='content').find_all('p')

for paragraph in paragraphs:

print(paragraph.get_text())

Это всего лишь пример того, как использовать Python для извлечения внутреннего содержимого HTML. В зависимости от структуры и требований вашего HTML-документа, вам потребуется использовать различные методы и фильтры BeautifulSoup. Однако, благодаря простоте использования и множеству возможностей Python и BeautifulSoup, вы можете легко извлекать нужную информацию с веб-страниц и использовать ее в своих проектах.

Зачем нужна разработка данных

В бизнесе разработка данных помогает компаниям анализировать и понимать свои операции, клиентов и конкурентов. Базируясь на данных, бизнес-аналитики могут принимать информированные решения, оптимизировать процессы и улучшать стратегию.

В государственном управлении разработка данных помогает правительствам принимать эффективные политические решения. Сбор и анализ данных позволяют изучать социально-экономические тенденции, оценивать эффективность программ и планировать развитие страны.

Использование Python для разработки данных становится все более популярным. Python – мощный и простой в использовании язык программирования, предлагающий множество библиотек и инструментов для анализа данных. С его помощью можно легко извлекать, обрабатывать и визуализировать данные, делать сложные вычисления и создавать прогнозы.

Короче говоря, разработка данных играет ключевую роль в современном мире. Она помогает нам принимать обоснованные решения, улучшать бизнес-процессы, расширять наше знание и проводить научные исследования. Python – мощный инструмент для работы с данными, который становится все более популярным.

Извлечение информации из HTML

Извлечение информации из HTML-кода может быть полезным, когда вам необходимо получить данные, находящиеся внутри веб-страницы. Python предоставляет мощные библиотеки для работы с HTML, такие как BeautifulSoup и lxml, которые позволяют легко и удобно осуществлять разбор HTML-кода.

Процесс извлечения информации из HTML обычно происходит в несколько шагов:

- Загрузка HTML-кода. На этом шаге вы можете использовать библиотеку requests, чтобы получить HTML-код веб-страницы с помощью URL-адреса.

- Разбор HTML-кода. После загрузки HTML-кода вам необходимо его разобрать для дальнейшего анализа. Для этого вы можете использовать BeautifulSoup или lxml.

- Навигация и поиск. После разбора HTML-кода вы можете использовать методы и функции, предоставляемые библиотекой, чтобы найти и извлечь нужную информацию. Например, вы можете найти все элементы с определенным тегом или классом или найти конкретное содержимое элемента по его атрибутам.

- Обработка и сохранение данных. После извлечения информации вы можете обработать ее с помощью Python и сохранить результат в нужном формате, например, в файле CSV или в базе данных.

Используя эти шаги и Python-библиотеки для работы с HTML, вы можете легко извлечь нужную информацию из веб-страниц и использовать ее для дальнейшего анализа или обработки данных.

Автоматизированная обработка больших объемов данных

Python является одним из самых популярных языков программирования, который широко используется для обработки данных. В Python существует множество библиотек и инструментов, предназначенных специально для работы с большими объемами данных.

| Библиотека | Описание |

|---|---|

| pandas | Мощная библиотека для анализа и обработки данных. Позволяет читать и записывать данные из различных форматов, выполнять операции с данными, фильтровать и группировать данные, а также строить графики и визуализации. |

| numpy | Библиотека для работы с многомерными массивами. Предоставляет высокопроизводительные математические функции, а также функционал для работы с линейной алгеброй, случайными числами и другими операциями. |

| scikit-learn | Библиотека машинного обучения. Предоставляет широкий спектр алгоритмов для классификации, регрессии, кластеризации и других задач машинного обучения. Легко интегрируется с другими библиотеками Python. |

| spark | Библиотека для параллельной обработки данных. Позволяет работать с данными в распределенной среде, эффективно использовать ресурсы кластера и выполнять сложные операции с большими объемами данных. |

Использование Python для автоматизированной обработки больших объемов данных позволяет существенно ускорить процесс обработки, повысить эффективность вычислений и улучшить качество результата. Однако, для работы с большими объемами данных необходимо учитывать особенности аппаратного обеспечения и использовать специализированные инструменты и системы.

Как использовать Python для извлечения данных

HTML — это язык разметки, который используется для создания веб-страниц. Каждая веб-страница состоит из HTML-кода. Для того чтобы извлечь данные из веб-страницы, необходимо проанализировать ее HTML-код и найти нужные элементы.

В Python для работы с HTML-кодом можно использовать различные библиотеки, такие как BeautifulSoup и lxml. С их помощью можно извлекать данные из HTML-кода, проводить поиск определенных элементов, извлекать атрибуты и текст.

Процесс извлечения данных из HTML-кода включает несколько шагов. Вначале необходимо получить HTML-код страницы, с которой нужно извлечь данные. Это можно сделать с помощью библиотеки requests, которая позволяет отправлять HTTP-запросы и получать ответы от веб-сервера.

Получив HTML-код страницы, следующим шагом является его анализ с помощью выбранной библиотеки. Для этого необходимо создать объект парсера, указать тип парсинга (HTML или XML) и передать HTML-код в парсер.

После этого можно использовать различные методы и функции библиотеки для поиска нужных элементов в HTML-коде и извлечения данных. Например, с помощью метода find можно найти первый элемент с заданным тегом или классом. С помощью метода find_all можно найти все элементы, удовлетворяющие заданному условию.

После того как нужные элементы найдены, можно использовать различные методы и атрибуты объектов библиотеки, чтобы извлечь нужные данные. Например, с помощью метода get_text можно извлечь текст из элемента, а с помощью атрибутов можно получить значения атрибутов элемента.

Использование Python для извлечения данных из HTML-кода позволяет автоматизировать процесс получения и обработки данных из веб-страниц. Это особенно полезно, когда нужно получить данные с нескольких страниц или обновлять данные регулярно.

Импорт библиотеки BeautifulSoup

Для захвата и обработки содержимого HTML-документа в Python мы можем использовать библиотеку BeautifulSoup. Данный инструмент позволяет удобно и эффективно извлекать информацию из HTML-страницы.

Перед использованием библиотеки BeautifulSoup необходимо установить ее при помощи менеджера пакетов pip:

- Откройте терминал или командную строку.

- Выполните команду

pip install beautifulsoup4.

После установки библиотеки мы можем импортировать ее в свой проект с помощью следующего кода:

from bs4 import BeautifulSoupТеперь мы можем использовать все функциональные возможности библиотеки BeautifulSoup для анализа HTML-страницы и извлечения нужных данных.

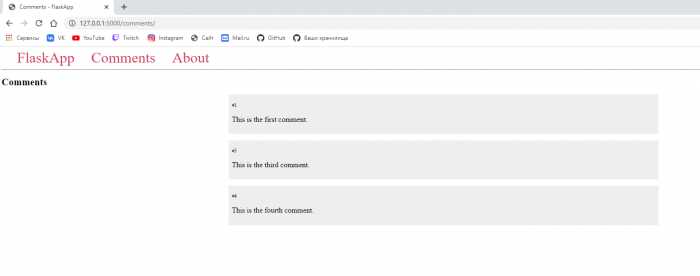

Парсинг HTML-страницы с использованием BeautifulSoup

При работе с HTML-страницами часто возникает необходимость извлечь информацию из их содержимого. Для этих целей мы можем использовать модуль BeautifulSoup в языке программирования Python, который упрощает парсинг HTML-кода.

Для начала необходимо установить BeautifulSoup. Это можно сделать с помощью менеджера пакетов pip:

pip install beautifulsoup4

После установки модуля мы можем начать парсинг HTML-страницы. Сначала необходимо импортировать необходимые библиотеки:

from bs4 import BeautifulSoup

Затем мы можем использовать функцию BeautifulSoup для создания объекта, содержащего HTML-код страницы:

soup = BeautifulSoup(html, 'html.parser')

В качестве аргумента html передается HTML-код страницы. Для его получения, например, можно использовать библиотеку requests:

import requests

response = requests.get(url)

html = response.text

Теперь мы можем использовать объект soup для работы с HTML-содержимым. Например, чтобы найти все теги на странице, мы можем использовать функцию find_all:

links = soup.find_all('a')

После этого мы можем проводить дополнительные операции с найденными элементами. Например, мы можем вывести текст и атрибут href каждого найденного тега :

for link in links:

print(link.text, link['href'])

Таким образом, использование модуля BeautifulSoup и языка Python позволяет упростить парсинг HTML-страницы и получение нужных данных из ее содержимого.

Примеры использования Python для парсинга HTML

Пример 1: Извлечение текста из HTML

import requests

from bs4 import BeautifulSoup

url = ‘https://www.example.com’

response = requests.get(url)

soup = BeautifulSoup(response.text, ‘html.parser’)

text = soup.get_text()

print(text)

В этом примере мы используем библиотеку requests для получения HTML-кода страницы и BeautifulSoup для его парсинга. Метод get_text() позволяет извлечь весь текст из HTML-кода страницы.

Пример 2: Извлечение списка ссылок из HTML

import requests

from bs4 import BeautifulSoup

url = ‘https://www.example.com’

response = requests.get(url)

soup = BeautifulSoup(response.text, ‘html.parser’)

links = soup.find_all(‘a’)

for link in links:

print(link[‘href’])

Пример 3: Извлечение данных из таблицы в HTML

import requests

from bs4 import BeautifulSoup

url = ‘https://www.example.com’

response = requests.get(url)

soup = BeautifulSoup(response.text, ‘html.parser’)

table = soup.find(‘table’)

rows = table.find_all(‘tr’)

for row in rows:

columns = row.find_all(‘td’)

for column in columns:

print(column.get_text())