Токенизация — это один из первых шагов в обработке естественного языка (Natural Language Processing, NLP). Она заключается в разделении текста на отдельные слова или группы слов, которые называются токенами. Токенизация важна для анализа текста, поиска ключевых слов, обучения моделей машинного обучения и многих других задач.

Python предлагает множество инструментов для токенизации текста. Одним из наиболее распространенных методов является использование регулярных выражений. Регулярные выражения — это специальные паттерны, которые используются для поиска и сопоставления текста. В Python для работы с регулярными выражениями есть модуль re, который предоставляет мощные функции для работы с текстом.

Для токенизации текста на отдельные слова можно использовать метод split(). Метод split() разделяет строку на части, используя заданный разделитель. В качестве разделителя может выступать пробел, запятая, точка или любой другой символ. Например, следующий код разделит текст на отдельные слова:

— text = «Привет, мир! Как дела?»

— words = text.split()

— print(words)

В результате выполнения кода вы получите список слов:

[‘Привет,’, ‘мир!’, ‘Как’, ‘дела?’]

Также существуют и другие методы и библиотеки для токенизации текста в Python, такие как NLTK (Natural Language Toolkit), SpaCy и др. Используя эти инструменты, вы можете проводить более сложные операции, такие как лемматизация, удаление стоп-слов и многое другое.

Токенизация группы слов в Python

В Python существует несколько способов выполнения токенизации группы слов. Один из самых простых способов — использование метода split(). Этот метод позволяет разделить строку на токены, основываясь на разделителе, который вы указываете.

Если вам нужно разделить текст на отдельные слова, вы можете использовать пробел в качестве разделителя:

text = "Привет, мир! Это пример текста."

tokens = text.split(" ")

print(tokens)

# Output: ['Привет,', 'мир!', 'Это', 'пример', 'текста.']

Однако этот метод не идеален, поскольку он не учитывает знаки препинания и другие элементы текста. Для более точной токенизации вы можете использовать регулярные выражения или специализированные библиотеки, такие как NLTK или SpaCy.

Токенизация является важным шагом в обработке текста и часто используется при анализе естественного языка, поиске информации, машинном обучении и других задачах обработки текста в Python.

Как разделить текст на слова

Один из способов — использование встроенной функции split(), которая разделяет строку на слова по заданному разделителю. Например, чтобы разделить текст на слова по пробелам, можно использовать следующий код:

text = «Привет, мир! Как дела?»

words = text.split(» «)

Результатом будет список, содержащий отдельные слова: [‘Привет,’, ‘мир!’, ‘Как’, ‘дела?’]

Также можно разделить текст на слова, используя регулярные выражения. Модуль re в Python предоставляет возможность работать с регулярными выражениями. Например, чтобы разделить текст на слова по пробелам и знакам препинания, можно использовать следующий код:

import re

text = «Привет, мир! Как дела?»

words = re.findall(r’\b\w+\b’, text)

Результатом будет список, содержащий слова: [‘Привет’, ‘мир’, ‘Как’, ‘дела’]

Выбор метода разделения текста на слова зависит от специфики задачи и требований к точности разделения. Экспериментируйте с различными подходами и выбирайте наиболее подходящий для вашего проекта.

Разделение строки на слова

В программировании часто возникает необходимость разделить строку на отдельные слова. Это может быть полезно при анализе текста, обработке данных или создании поисковых функций. В языке Python существует несколько способов токенизации строки на слова.

Один из самых простых и популярных способов разделения строки на слова — использование функции split(). Эта функция разделяет строку на слова по пробелам и возвращает список слов.

Например, следующий код разделит строку «Привет, мир! Как дела?» на отдельные слова:

s = "Привет, мир! Как дела?"

words = s.split()

print(words)

Результат выполнения программы будет следующим:

['Привет,', 'мир!', 'Как', 'дела?']

Если в строке несколько пробелов между словами или есть знаки препинания, то функция split() все равно правильно разделит строку на слова.

Также в Python существуют специализированные библиотеки для работы с текстом, такие как Natural Language Toolkit (NLTK) и SpaCy, которые позволяют проводить более сложную токенизацию, учитывая различные правила и особенности языка.

Разделение строки на слова — важный шаг при обработке текста с помощью программирования на Python. Используйте функцию split() или специализированные библиотеки в зависимости от сложности задачи и требуемой точности токенизации.

Использование встроенных методов для токенизации

Один из таких методов — метод split(). Он позволяет разделить строку на слова, исходя из определенного разделителя. Например, следующий код разделяет строку на слова, используя пробел в качестве разделителя:

text = "Пример строки, подлежащей токенизации"

tokens = text.split()

print(tokens)

В результате выполнения кода мы получим список, содержащий каждое слово строки:

['Пример', 'строки,', 'подлежащей', 'токенизации']

Если же мы хотим разделить текст на слова, исходя из других разделителей, мы можем передать нужный разделитель в качестве аргумента метода split(). Например, следующий код разделит строку на слова, используя запятую в качестве разделителя:

text = "Пример строки, подлежащей токенизации"

tokens = text.split(",")

print(tokens)

В результате мы получим следующий список:

['Пример строки', ' подлежащей токенизации']

Еще одним методом для токенизации является регулярное выражение, представленное в Python модулем re. С помощью этого модуля мы можем использовать более сложные правила для разделения текста на токены.

Например, следующий код использует регулярное выражение для разделения текста на слова, игнорируя всякие знаки препинания и пробелы:

import re

text = "Пример строки, подлежащей токенизации!"

tokens = re.findall(r'\w+', text)

print(tokens)

В результате мы получим список, содержащий каждое слово строки без знаков препинания:

['Пример', 'строки', 'подлежащей', 'токенизации']

Использование встроенных методов для токенизации упрощает работу с текстом, позволяя разделить его на отдельные слова или токены с минимальными усилиями.

Применение библиотек для более сложной токенизации

Одной из самых популярных библиотек для токенизации в Python является NLTK (Natural Language Toolkit). NLTK предоставляет различные методы для токенизации, включая разделение текста на отдельные слова, удаление пунктуации, разделение на предложения и многое другое.

Еще одной мощной библиотекой для токенизации текста является SpaCy. SpaCy предоставляет более сложные и продвинутые алгоритмы токенизации, которые учитывают контекст и грамматику. Она также обладает быстрой производительностью и поддерживает множество языков.

Кроме того, существуют и другие библиотеки, такие как TextBlob, Gensim и CoreNLP, которые также предоставляют различные методы для токенизации текста. Они могут быть полезны при работе с конкретными типами текста или в задачах, связанных с анализом семантики, классификацией и машинным обучением.

Важно выбирать подходящую библиотеку для токенизации, исходя из специфики задачи и требуемых характеристик обработки текста. Библиотеки для более сложной токенизации могут быть полезны при работе с текстами, содержащими специфические имена собственные, сложные грамматические конструкции или диалекты.

Отличительной особенностью применения библиотек для более сложной токенизации является то, что они позволяют более точно и корректно разделять текст на токены, учитывая особенности языка и контекста. Это может быть особенно полезно для NLP-задач, таких как анализ тональности, сентимент-анализ, машинный перевод и многое другое.

Советы по токенизации

Вот несколько советов, которые помогут вам эффективно провести токенизацию:

- Используйте готовые библиотеки: Python предлагает множество библиотек, таких как NLTK, SpaCy и PyTorch, которые имеют встроенные инструменты для токенизации текста. Они предоставят вам готовые модели и алгоритмы, что сэкономит ваше время и упростит процесс.

- Учитывайте особенности языка: каждый язык имеет свои особенности, и правила токенизации могут отличаться. Некоторые языки могут иметь специфические символы или правила, которые необходимо учесть для точной токенизации.

- Разбивайте на токены с учётом контекста: в зависимости от задачи, которую вы решаете, может быть полезно учитывать контекст, в котором находится текст. Некоторые слова могут иметь разные значения в разных контекстах, и правильное разделение на токены может помочь в их правильной интерпретации.

- Удаляйте ненужные символы: перед токенизацией может быть полезно удалить ненужные символы, такие как знаки препинания или специальные символы, чтобы не засорять результаты. Но будьте осторожны, чтобы не удалить символы, которые могут быть важны для правильного понимания текста.

- Используйте правила и регулярные выражения: иногда может потребоваться создание собственных правил или регулярных выражений для токенизации текста. Например, для извлечения аббревиатур или специфических терминов.

Помните, что правильная токенизация может положительно сказаться на качестве и точности вашей работы. Надеемся, что эти советы помогут вам провести токенизацию эффективно и достичь желаемых результатов.

Учесть разделители

При токенизации группы слов в Python, важно учесть различные разделители, чтобы правильно разделить текст на слова.

Разделители могут быть пробелами, запятыми, точками, восклицательными и вопросительными знаками, а также другими знаками пунктуации.

Чтобы правильно разделить текст на слова, можно использовать различные методы и функции языка Python, такие как split() или регулярные выражения.

Регулярные выражения позволяют задать шаблон для разделителя и разделить текст на слова, основываясь на этом шаблоне.

Важно помнить, что при разделении текста на слова, также нужно обрабатывать случаи сокращений, чисел, символов и других специфических случаев.

Учитывая разделители при токенизации текста помогает достичь более точных результатов и облегчает дальнейшую обработку данных.

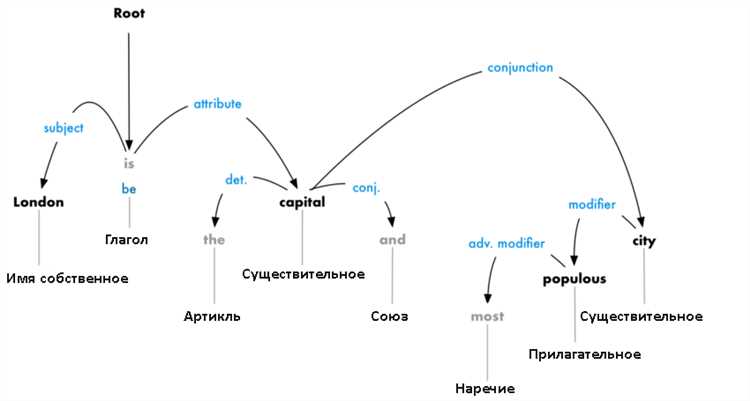

Ориентироваться на контекст

При токенизации группы слов в Python очень важно учитывать контекст, в котором находятся слова. Контекст может давать дополнительную информацию о значении слова и его использовании. Правильное разделение текста на слова помогает понять смысл предложения или абзаца и делает последующую обработку текста более точной и эффективной.

Для разделения текста на слова можно использовать различные методы токенизации, такие как использование пробелов и знаков пунктуации, использование словарей или даже машинного обучения. Однако, независимо от выбранного метода, важно учитывать контекст при разделении слов.

Например, в предложении «Я путешествую в Германию» слово «Германию» должно быть разделено как отдельный токен, чтобы его можно было правильно идентифицировать и обрабатывать. Если слово «Германию» будет разделено на два отдельных слова «Германия» и «у», потеряется его контекст и смысл.

Также, важно учитывать контекст при обработке слов. Например, в предложении «Я не хочу идти в зоопарк» слово «не» должно быть связано с предшествующим словом «хочу» для правильного понимания предложения. Если слово «не» будет отделено от слова «хочу», предложение может стать непонятным или иметь неверный смысл.

Поэтому, при токенизации группы слов в Python, всегда важно ориентироваться на контекст и учитывать его при разделении текста на слова. Это поможет сохранить смысл и целостность текста и обеспечит более точную и эффективную обработку текстовых данных.

Использовать регулярные выражения

Регулярные выражения представляют мощный инструмент для обработки текста в языке программирования Python. Они позволяют выполнять различные операции с текстом, такие как поиск, замена, разделение и многое другое.

Одним из наиболее распространенных применений регулярных выражений является токенизация группы слов. Токенизация представляет процесс разделения текста на отдельные слова или токены. Использование регулярных выражений позволяет с легкостью разбить текст на слова, игнорируя знаки препинания и другие символы.

Для использования регулярных выражений в Python, необходимо импортировать соответствующий модуль re. В этом модуле содержатся различные функции и методы для работы с регулярными выражениями.

Процесс токенизации группы слов с использованием регулярных выражений можно выполнить следующим образом:

- Импортировать модуль

re:import re - Определить текст, который требуется разделить на слова. Например:

text = "Привет, мир! Как дела?" - Использовать метод

split()из модуляre, чтобы разделить текст на слова. Например:words = re.split(r'\W+', text) - Результат будет представлен в виде списка слов. Например:

print(words) # ['Привет', 'мир', 'Как', 'дела']

Использование регулярных выражений при токенизации группы слов позволяет удобно и эффективно обрабатывать текст в Python. Этот инструмент становится особенно полезным при работе с большими объемами данных, где нужно обработать тексты для дальнейшего анализа или использования.