Оптимизация работы с памятью является одним из важных аспектов разработки программ на Python. Ведь часто недостаточная эффективность работы с памятью может сильно замедлить выполнение программы и повлиять на ее производительность.

Существует несколько методов и советов, которые помогут ускорить работу с памятью в Python и оптимизировать процесс выполнения кода. В этой статье мы рассмотрим некоторые из самых эффективных и универсальных подходов к увеличению скорости работы памяти.

Первый совет — использовать встроенные структуры данных Python, такие как списки и словари, вместо создания и использования собственных структур данных. Встроенные структуры данных оптимизированы на уровне языка и работают значительно быстрее, чем пользовательские реализации.

Второй совет — правильно использовать генераторы и итераторы. Генераторы позволяют создавать итерируемые объекты, но при этом не загружают память полностью, а генерируют значения по мере необходимости. Это позволяет сократить расход памяти и увеличить скорость работы программы.

- Улучшение скорости работы памяти в Python с помощью оптимизации кода

- Удаление ненужных переменных

- Использование быстродействующих функций

- Оптимизация циклов

- Повышение скорости работы памяти в Python с использованием библиотек

- NumPy

- Pandas

- Cython

- Оптимизация использования памяти в Python при работе с большими данными

Улучшение скорости работы памяти в Python с помощью оптимизации кода

Один из первых шагов в оптимизации кода — это избегать повторных вычислений. Вместо того, чтобы повторно вычислять одни и те же значения, можно сохранить их в переменных и использовать их снова. Это особенно полезно при работе с большими данными или в циклах.

Также можно улучшить скорость работы памяти, используя более эффективные алгоритмы и структуры данных. Например, использование словарей вместо списков позволяет получить быстрый доступ к элементам и оптимизировать использование памяти.

Еще одним способом оптимизации кода является использование генераторов. Генераторы позволяют производить значения по мере необходимости, вместо того чтобы создавать их заранее и хранить в памяти. Это особенно полезно при работе с большими наборами данных или при работе с итерируемыми объектами.

Кроме того, можно использовать конструкцию with, чтобы автоматически закрыть ресурсы и освободить память после их использования. Например, при работе с файлами или базами данных.

Наконец, стоит обратить внимание на использование модулей сторонних разработчиков. Часто они уже оптимизированы и предлагают более эффективные решения для работы с памятью.

Важно помнить, что оптимизация кода может занять время и требует некоторых усилий, но в итоге она может значительно улучшить скорость работы памяти и производительность вашей программы в Python.

Удаление ненужных переменных

Для удаления переменной в Python можно использовать оператор del. Например, если у вас есть переменная x и вы хотите удалить ее, просто напишите del x. Это удалит переменную из памяти и освободит занимаемое ею место.

Чтобы удалить несколько переменных сразу, можно использовать оператор del сразу для всех переменных, разделенных запятой. Например, del x, y, z.

Оператор del также может быть использован для удаления элементов из списков, словарей и других коллекций. Например, чтобы удалить элемент с индексом 0 из списка my_list, можно написать del my_list[0].

Важно отметить, что удаление переменных может быть опасным, если они все еще используются в других частях программы. Поэтому перед удалением переменной рекомендуется убедиться, что она больше не нужна или что все ее использования были обработаны.

Удаление ненужных переменных является важной частью оптимизации памяти в Python. Пользуйтесь оператором del, чтобы освободить память, занимаемую ненужными переменными, и повысить скорость работы вашей программы.

Использование быстродействующих функций

Чтобы использовать быстродействующие функции, нужно знать, как их найти и использовать. В Python существует несколько способов получить доступ к таким функциям. Один из них — использовать встроенные модули, которые содержат оптимизированные функции для выполнения распространенных задач. Например, модуль numpy предоставляет функции для работы с массивами чисел, которые работают намного быстрее, чем стандартные функции Python.

Еще один способ использования быстродействующих функций — использование сторонних библиотек. В Python существует множество библиотек, которые предоставляют оптимизированные функции для различных задач. Например, библиотеки pandas и scikit-learn предоставляют быстродействующие функции для работы с данными и машинного обучения соответственно.

Необходимо указать, что использование быстродействующих функций может иметь свои недостатки. Некоторые из них могут быть сложными в использовании, требовать определенных навыков или быть специфичными для определенных задач. Поэтому перед использованием таких функций необходимо оценить их применимость к конкретной задаче и изучить их документацию.

Оптимизация циклов

Одна из основных техник оптимизации циклов — предварительное объявление переменных перед циклом и использование оператора распаковки при присваивании значений элементов списка. Это позволяет уменьшить время выполнения цикла, так как интерпретатор Python будет знать заранее, сколько переменных должно быть создано и сколько значений должно быть распаковано.

Кроме того, можно использовать встроенные функции Python, такие как map(), filter() и reduce(), для замены традиционных циклов. Эти функции выполняют определенные действия над элементами списка или итерируемого объекта и являются более эффективными с точки зрения памяти и времени выполнения.

Еще одной полезной техникой является использование генераторов списков (list comprehensions) вместо традиционных циклов. Генераторы списков позволяют создавать списки более компактно и эффективно, не требуя создания отдельного цикла.

Также следует обратить внимание на такие вещи, как вынос независимых вычислений из цикла и стандартные оптимизации, такие как замена внутренних циклов на функции или использование срезов.

Использование этих методов и советов поможет вам значительно увеличить скорость работы памяти в Python и повысить эффективность выполнения кода.

Повышение скорости работы памяти в Python с использованием библиотек

Одной из таких библиотек является NumPy. Она предоставляет мощные инструменты для работы с многомерными массивами и выполняет операции над ними гораздо быстрее, чем стандартная библиотека Python. Также NumPy использует оптимизированные алгоритмы для работы с числовыми данными, что позволяет значительно ускорить время выполнения операций.

Еще одной полезной библиотекой для оптимизации работы памяти является Pandas. Она предоставляет высокоуровневый и гибкий инструментарий для обработки и анализа данных. Pandas использует структуры данных, такие как DataFrames, которые позволяют эффективно хранить и манипулировать большими объемами данных. Благодаря своей эффективности Pandas позволяет ускорить процессы обработки и анализа данных по сравнению с обычными методами в Python.

Также стоит обратить внимание на библиотеку TensorFlow, которая предоставляет удобные инструменты для работы с нейронными сетями и машинным обучением. TensorFlow использует реализацию графа вычислений, что позволяет оптимизировать использование памяти и ускорить выполнение сложных операций над данными.

Внедрение этих библиотек может значительно повысить скорость работы памяти в Python. Они предоставляют оптимизированные алгоритмы и структуры данных, которые помогают ускорить выполнение операций и эффективно использовать память. Используя эти библиотеки, разработчики могут значительно увеличить производительность своих программ и снизить нагрузку на память.

NumPy

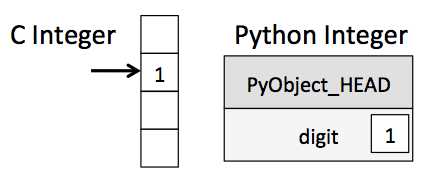

Одна из самых заметных особенностей NumPy — это его скорость работы с массивами данных. Массивы NumPy работают намного быстрее, чем встроенные массивы Python, потому что они представляют собой непрерывный блок памяти, что улучшает доступ к данным и минимизирует накладные расходы. Кроме того, NumPy использует эффективные алгоритмы для выполнения различных операций над массивами, таких как суммирование, умножение и т.д., что также ускоряет работу с данными.

Библиотека NumPy предлагает множество функций и методов для работы с массивами данных, включая операции по выборке, фильтрации, манипуляции и агрегации данных. Она также поддерживает математические операции, линейную алгебру, статистику и т.д. Все это делает NumPy мощным инструментом для работы с массивами данных в Python.

Основным преимуществом использования NumPy для работы с массивами данных является его производительность. Благодаря оптимизированным алгоритмам и эффективному использованию памяти, NumPy позволяет оперировать с большими объемами данных значительно быстрее, чем встроенные массивы Python. Это особенно важно, когда вы работаете с большими массивами данных или выполняете вычислительно сложные операции.

Кроме того, NumPy обладает широкой поддержкой в различных областях науки и инженерии, таких как физика, биология, экономика, машинное обучение и др. Его функциональность и удобство использования делают NumPy популярным инструментом среди исследователей, разработчиков и аналитиков данных.

Pandas

Одной из главных проблем при работе с большими объемами данных является скорость работы. В Pandas есть несколько методов и советов, которые могут помочь увеличить скорость работы памяти в Python.

Один из таких методов — использование векторизации операций. Вместо того, чтобы выполнять циклы по элементам данных, можно использовать векторные операции, которые выполняются сразу над всеми элементами структуры данных. Это может значительно увеличить скорость работы программы.

Еще один полезный метод — использование методов Pandas для фильтрации и сортировки данных. Вместо того, чтобы писать сложные циклы и условия, можно использовать методы DataFrame, такие как .loc и .sort_values, чтобы легко выполнить нужные операции.

Также можно использовать различные методы оптимизации, такие как использование индексов, сжатие данных и заполнение пропущенных значений. В Pandas есть много встроенных функций, которые могут помочь в этом.

Кроме того, для увеличения скорости работы памяти в Python можно использовать параллельные операции. Некоторые операции в Pandas можно выполнять параллельно, что может значительно ускорить работу программы.

| Метод | Описание |

|---|---|

| Векторизация | Использование векторных операций для ускорения работы программы. |

| Методы фильтрации и сортировки | Использование методов .loc и .sort_values для удобной работы с данными. |

| Оптимизация данных | Использование индексов, сжатия данных и заполнения пропущенных значений. |

| Параллельные операции | Использование параллельных операций для ускорения работы программы. |

Cython

Основной принцип работы Cython состоит в том, что он позволяет добавлять статические типы к переменным и функциям, что устраняет накладные расходы, связанные с интерпретацией типов Python. Кроме того, Cython поддерживает C-подобный синтаксис и может генерировать оптимизированный C-код, который может быть компилирован в машинный код. Результатом использования Cython является ускорение выполнения кода до нескольких раз по сравнению с чистым Python.

Важно отметить, что для работы с Cython необходимо иметь компилятор C/C++. После написания кода на Cython он должен быть скомпилирован в расширение Python с использованием специального скрипта или командной строки. Затем это расширение можно импортировать и использовать в Python-программах, получая при этом высокую скорость выполнения.

Примечание: использование Cython может потребовать некоторого времени и изучения своего синтаксиса. Однако, если необходимо увеличить производительность программы на Python, то использование Cython может быть эффективным решением.

Оптимизация использования памяти в Python при работе с большими данными

Существуют различные методы и советы, которые помогут вам оптимизировать использование памяти в Python для работы с большими данными. Вот некоторые из них:

- Используйте генераторы: Генераторы — это специальный тип функций, которые возвращают объекты, которые можно перебрать. Они позволяют генерировать данные по мере их необходимости, вместо хранения всех данных в памяти одновременно. Это особенно полезно при работе с большими объемами данных.

- Используйте итераторы: Итераторы — это объекты, которые можно перебрать, такие как списки, кортежи или словари. Они позволяют вам обрабатывать данные по частям, вместо загрузки их всех сразу в память. Использование итераторов поможет сократить использование памяти в ваших программах.

- Используйте срезы: Срезы позволяют выбирать только необходимые части данных из списка, кортежа или строки. Если вы работаете с большими данными и вам необходимо обрабатывать только часть информации, использование срезов поможет снизить использование памяти.

- Удалите ненужные объекты: В Python существует сборщик мусора, который автоматически освобождает память из-под объектов, которые больше не используются. Однако, иногда может возникать ситуация, когда вы знаете, что объект больше не нужен, и вы можете удалить его вручную с помощью оператора

del. Это позволит сэкономить использование памяти. - Используйте библиотеки для работы с большими данными: Существуют специализированные библиотеки, такие как Pandas и NumPy, которые оптимизированы для работы с большими объемами данных. Использование этих библиотек может значительно ускорить обработку данных и снизить использование памяти.

Следуя этим методам и советам, вы сможете оптимизировать использование памяти в Python при работе с большими данными и повысить скорость работы вашей программы.