Машинное обучение – это уникальная область компьютерных наук, которая позволяет компьютерам учиться и делать прогнозы на основе имеющихся данных. Оно проникает во все сферы нашей жизни, от автоматического распознавания лиц на фотографиях до подбора рекомендаций на стриминговых сервисах. Однако, погружение в эту область может оказаться глубоким и сложным путем.

Python – один из самых популярных языков программирования, который широко используется в машинном обучении. С его помощью можно создавать мощные алгоритмы и модели, которые способны извлекать полезную информацию из огромных объемов данных. Однако, работа с машинным обучением в Python требует от программиста глубоких знаний и умений.

Машинное обучение в Python включает в себя множество концепций, методов и алгоритмов, которые могут быть сложными для понимания на первых этапах изучения. Одна из главных сложностей заключается в понимании и обработке больших объемов данных, а также в выборе и настройке подходящих моделей для решения конкретных задач.

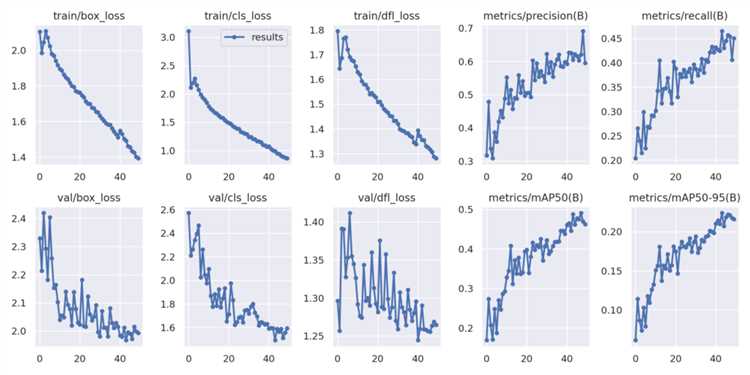

Весь путь машинного обучения в Python может быть сопряжен с более чем 50 потерями, включая потерю времени, данных, результатов и мотивации. Сложность задач и необходимость постоянного обучения и адаптации к новым методам и технологиям могут стать причиной отказа от продолжения изучения этой области.

Однако, несмотря на сложности, машинное обучение в Python предлагает огромные возможности для разработки инновационных решений и расширения пределов наших знаний. Успешные проекты и исследования в этой области могут привести к новым открытиям и существенным улучшениям в наших повседневных задачах.

- Глубокое машинное обучение в Python

- Основы глубокого обучения

- Популярные библиотеки Python для глубокого обучения

- Сложности глубокого обучения

- Переобучение и недообучение моделей

- Проблема выбора оптимальной архитектуры модели

- Методы сокращения потерь в глубоком обучении

- Алгоритмы оптимизации в глубоком обучении

Глубокое машинное обучение в Python

Python — это один из самых популярных языков программирования для машинного обучения. Он предлагает широкий набор инструментов и библиотек, таких как TensorFlow и Keras, которые облегчают разработку и реализацию алгоритмов глубокого машинного обучения.

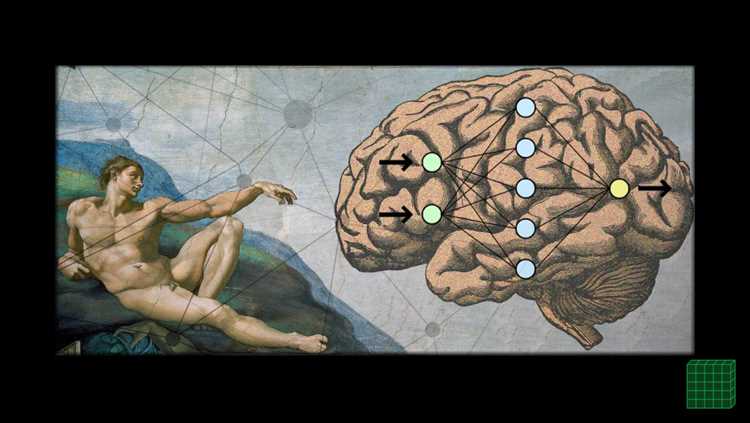

Глубокое машинное обучение в Python может быть использовано для решения различных задач, таких как распознавание изображений, обработка естественного языка, анализ данных и многое другое. За счет использования нейросетей с большим количеством слоев, глубокое машинное обучение дает возможность распознавать более сложные паттерны и делать более точные прогнозы.

Одним из ключевых преимуществ глубокого машинного обучения является возможность автоматического извлечения признаков из данных. Это позволяет моделям самостоятельно определять наиболее важные характеристики, не требуя предварительного определения признаков человеком. Это делает глубокое машинное обучение более гибким и эффективным для обработки различных типов данных.

Тем не менее, глубокое машинное обучение в Python также имеет свои сложности. Оно требует больших вычислительных ресурсов и времени для обучения моделей, особенно если данные очень большие. Также требуется глубокое понимание алгоритмов и методов, чтобы правильно настроить и оптимизировать модели.

Все это делает глубокое машинное обучение в Python увлекательным и сложным путем для исследователей и разработчиков. Но с правильным пониманием и опытом, оно может принести значительные результаты и открытия в мире искусственного интеллекта и анализа данных.

Основы глубокого обучения

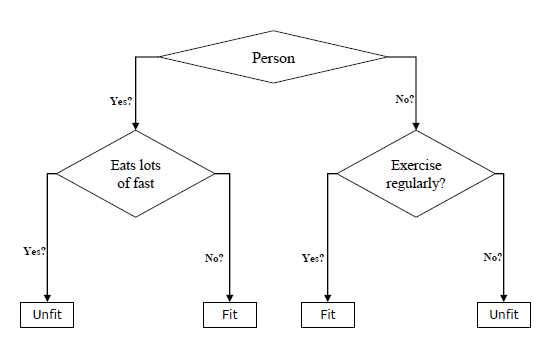

Глубокое обучение позволяет создавать модели, способные решать сложные задачи, такие как распознавание речи, классификация изображений, прогнозирование временных рядов и многое другое. Это достигается путем обучения нейронных сетей на больших объемах данных и тонкой настройки их параметров для достижения наилучших результатов.

Основа глубокого обучения — это архитектура нейронной сети и ее компоненты. Основные компоненты включают в себя входной слой, скрытые слои и выходной слой. Каждый слой состоит из нейронов, которые считывают данные с предыдущего слоя, обрабатывают их и передают на следующий слой.

Для обучения нейронной сети используется алгоритм обратного распространения ошибки. Он позволяет настраивать веса и смещения нейронов таким образом, чтобы минимизировать ошибку модели на тренировочных данных. После обучения, модель может быть использована для предсказания значений на новых данных.

Глубокое обучение использует множество различных функций активации, таких как Sigmoid, ReLU, Softmax и другие. Они позволяют нелинейной модели предсказывать сложные зависимости между входными и выходными данными.

Одним из основных преимуществ глубокого обучения является его способность автоматически извлекать признаки из данных. Например, при обучении нейронной сети на изображениях, модель сама находит важные черты (края, текстуры, формы и т.д.), не требуя ручной разметки данных.

Однако глубокое обучение также имеет свои ограничения. Оно требует большого количества данных для успешного обучения и долгого времени для обработки. Также, при неправильной настройке модели, возможно переобучение или недообучение.

В целом, глубокое обучение представляет собой мощный инструмент для анализа и обработки данных. С его помощью можно решать сложные задачи, что делает его одним из наиболее востребованных направлений в машинном обучении.

Популярные библиотеки Python для глубокого обучения

- TensorFlow: Данная библиотека разработана командой Google Brain и является одной из наиболее популярных библиотек для глубокого обучения. Она предоставляет мощные инструменты для создания и обучения нейронных сетей, а также для распределенного обучения и использования графических процессоров.

- Keras: Это высокоуровневый фреймворк для глубокого обучения, который является надстройкой над TensorFlow и другими низкоуровневыми библиотеками. Keras обладает простым и интуитивно понятным интерфейсом, что делает его очень популярным среди начинающих исследователей в области глубокого обучения.

- PyTorch: Это фреймворк глубокого обучения, разработанный командой Facebook AI Research. PyTorch предоставляет гибкую и мощную систему для создания и обучения нейронных сетей. Он активно используется в научных исследованиях и разработке прототипов, благодаря своей простоте и удобству.

- Caffe: Это популярная библиотека глубокого обучения, особенно популярная в области компьютерного зрения. Caffe предоставляет эффективные инструменты для создания и обучения сверточных нейронных сетей. Он был разработан командой Беркли и активно используется в академических и промышленных проектах.

- Theano: Это библиотека глубокого обучения, которая была разработана для оптимизации математических вычислений с использованием графических процессоров. Theano предоставляет удобный интерфейс для создания и обучения нейронных сетей. Однако, разработка Theano была остановлена, и на сегодняшний день рекомендуется использовать другие библиотеки, такие как TensorFlow или PyTorch.

Конечно, это не полный список всех библиотек Python для глубокого обучения, но они являются наиболее популярными и широко используемыми. Выбор конкретной библиотеки зависит от задачи, предпочтений и опыта исследователя. С помощью этих библиотек можно создавать и обучать сложные модели глубокого обучения и решать разнообразные задачи в области машинного обучения.

Сложности глубокого обучения

Первая сложность глубокого обучения – это выбор оптимальной архитектуры нейронной сети. В зависимости от задачи, требуется выбрать наиболее подходящий тип нейронной сети и определить количество слоев, их размерности, типы активационных функций и другие параметры. Это может быть затруднительным и требует большого объема экспериментов и исследований.

Вторая сложность – это большое количество данных, необходимых для обучения нейронной сети. Глубокие модели требуют большого объема данных для достижения хороших результатов. Недостаточное количество данных может привести к переобучению или недообучению модели. Сбор и подготовка подходящих данных может быть длительным и трудоемким процессом.

Третья сложность – это требования к ресурсам. Глубокое обучение требует больших вычислительных мощностей и объема памяти для обучения и работы модели. Использование графических процессоров (GPU) может ускорить процесс обучения, но требует дополнительных ресурсов и знаний.

Кроме того, глубокое обучение может столкнуться с проблемой переобучения. Если модель обучается на слишком большом количестве данных или слишком сложной архитектуре, она может выучить шум и несуществующие закономерности, что может снизить ее обобщающую способность.

Переобучение и недообучение моделей

Переобучение модели происходит, когда она слишком хорошо запомнила все особенности обучающих данных, но не может достаточно точно предсказывать значения для новых данных. Это связано с тем, что модель слишком «сложная» и «специфичная» для конкретного набора данных, и она не может обобщить полученные знания на другие данные.

Однако недообучение модели возникает, когда она не смогла изучить все существенные закономерности в данных и не может достаточно точно предсказывать значения для каких-то конкретных случаев. Это происходит, когда модель слишком «простая» и не может адекватно описать сложности в данных.

Для решения проблемы переобучения, можно использовать методы регуляризации, такие как L1 или L2 регуляризация, которые добавляют штрафные члены к функции потерь модели. Это позволяет снизить влияние отдельных признаков и помогает модели обобщить полученные знания более точно.

А для решения проблемы недообучения, можно использовать методы аугментации данных, такие как добавление случайного шума к обучающим примерам или искажение изображений. Это позволяет «обогатить» обучающие данные и увеличить их разнообразие, что может помочь модели научиться более точно описывать закономерности в данных.

Выбор оптимального баланса между переобучением и недообучением моделей является важной задачей в машинном обучении. Для этого можно использовать методы кросс-валидации, которые позволяют проверить обобщающую способность модели на отдельных частях данных, а также использовать выборки проверки. Также очень важно следить за метриками качества модели и анализировать графики обучения для определения наличия переобучения или недообучения.

В итоге, переобучение и недообучение моделей являются серьезными проблемами при работе с машинным обучением, которые требуют специального подхода и методов для их решения. Только достигнув оптимального баланса, можно получить надежные и точные предсказания с использованием моделей машинного обучения.

Проблема выбора оптимальной архитектуры модели

Выбор оптимальной архитектуры модели влияет на ее производительность, эффективность и способность к обучению и предсказанию. Ошибка в выборе архитектуры может привести к низкой точности модели, долгому времени обучения или нежелательному переобучению.

Одним из основных подходов к выбору оптимальной архитектуры модели является применение эмпирического подхода, основанного на опыте и экспериментах. Этот подход заключается в последовательном изменении архитектуры модели и анализе полученных результатов. Например, можно попробовать увеличить количество слоев или нейронов в модели и проверить, как это влияет на точность и время обучения.

Также следует учитывать особенности конкретной задачи машинного обучения и доступные ресурсы. Например, если у вас ограничены вычислительные мощности, то стоит выбрать более простую архитектуру с меньшим количеством параметров.

Для выбора оптимальной архитектуры модели также можно использовать методы оптимизации, такие как Grid Search или Random Search. Эти методы позволяют автоматически подобрать наилучшие параметры модели путем перебора различных вариантов.

В итоге, выбор оптимальной архитектуры модели является сложным и многогранным процессом, который требует опыта, экспериментов и учета особенностей конкретной задачи. Важно помнить, что нет универсальной «серебряной пули» в выборе архитектуры, и это непрерывный процесс, в котором нужно постоянно искать лучший вариант.

Методы сокращения потерь в глубоком обучении

Для решения этой проблемы были разработаны различные методы сокращения потерь в глубоком обучении. Одним из таких методов является регуляризация. Регуляризация позволяет уменьшить переобучение модели путем добавления штрафа к функции потерь. Это уменьшает веса нейронных связей и помогает избежать чрезмерной адаптации к тренировочным данным.

Еще одним методом сокращения потерь является оптимизация параметров модели. Это включает в себя выбор оптимальных значений параметров и весов модели, которые минимизируют функцию потерь. Для этого используются различные алгоритмы оптимизации, такие как градиентный спуск и стохастический градиентный спуск.

Кроме того, методы сокращения потерь в глубоком обучении также включают использование различных архитектур нейронных сетей. Например, сверточные нейронные сети (Convolutional Neural Networks, CNN) широко применяются для обработки изображений, а рекуррентные нейронные сети (Recurrent Neural Networks, RNN) эффективно работают с последовательными данными, такими как тексты и речь.

Важно отметить, что выбор и комбинация этих методов зависит от конкретной задачи и набора данных. Нет универсального решения для сокращения потерь, и иногда может потребоваться пробовать разные подходы для достижения наилучших результатов.

Алгоритмы оптимизации в глубоком обучении

Алгоритмы оптимизации в глубоком обучении направлены на то, чтобы настроить параметры моделей таким образом, чтобы минимизировать функцию потерь и улучшить качество предсказаний. Эти алгоритмы позволяют находить оптимальные значения параметров, которые производят наилучшие результаты при работе с большими объемами данных.

Одним из популярных алгоритмов оптимизации в глубоком обучении является градиентный спуск. Он основывается на вычислении градиента функции потерь по параметрам модели и последующем обновлении этих параметров в направлении, противоположном градиенту. Таким образом, градиентный спуск позволяет итеративно приближаться к оптимальным значениям параметров.

Еще одним важным алгоритмом оптимизации является стохастический градиентный спуск. В отличие от обычного градиентного спуска, который вычисляет градиент по всей обучающей выборке, стохастический градиентный спуск вычисляет градиент только по одному случайно выбранному образцу. Это позволяет активно использовать большие объемы данных, ускоряя процесс обучения нейронных сетей.

Также стоит отметить алгоритмы оптимизации, основанные на методах второго порядка, такие как метод Бройдена – Флетчера – Гольдфарба – Шанно. Эти алгоритмы используют информацию о гессиане (матрице вторых производных) функции потерь для эффективного поиска оптимального решения. Они позволяют осуществлять более точную и быструю оптимизацию параметров моделей.

В последнее время, с развитием исследований в области глубокого обучения, появляются новые алгоритмы оптимизации, которые учитывают специфические особенности работы сетей глубокого обучения. Такие алгоритмы, как Adam, RMSprop, AdaDelta, позволяют эффективно настраивать параметры моделей и достигать высоких результатов на различных задачах.

Алгоритмы оптимизации в глубоком обучении играют важную роль в процессе обучения нейронных сетей и оптимизации параметров моделей. Использование эффективных алгоритмов помогает ускорить процесс обучения, повысить точность предсказаний и обеспечить успешное решение сложных задач в различных областях.