Pandas – это высокоуровневая библиотека языка программирования Python, которая предоставляет инструменты для обработки и анализа структурированных данных. Однако, при работе с большими наборами данных, пользователи часто сталкиваются с проблемой медленного объединения таблиц.

Основная причина проблемы заключается в неэффективности алгоритмов, используемых внутри библиотеки Pandas для выполнения операций объединения. Когда объединение происходит для больших наборов данных, алгоритмы могут сталкиваться с ограничениями по памяти и время выполнения может значительно увеличиваться.

Для решения проблемы можно использовать несколько стратегий. Во-первых, можно оптимизировать процесс объединения, выбрав оптимальные параметры для используемых функций. Например, можно выбрать правильные алгоритмы объединения и настроить параметры памяти для ускорения выполнения операций.

Во-вторых, можно разделить операцию объединения на несколько шагов и использовать параллельное выполнение. Это позволит использовать все доступные ядра процессора и ускорит процесс обработки данных. Кроме того, можно использовать специализированные библиотеки для работы с большими наборами данных, такие как Dask или Modin, которые предлагают более эффективные алгоритмы объединения и автоматическую параллелизацию операций.

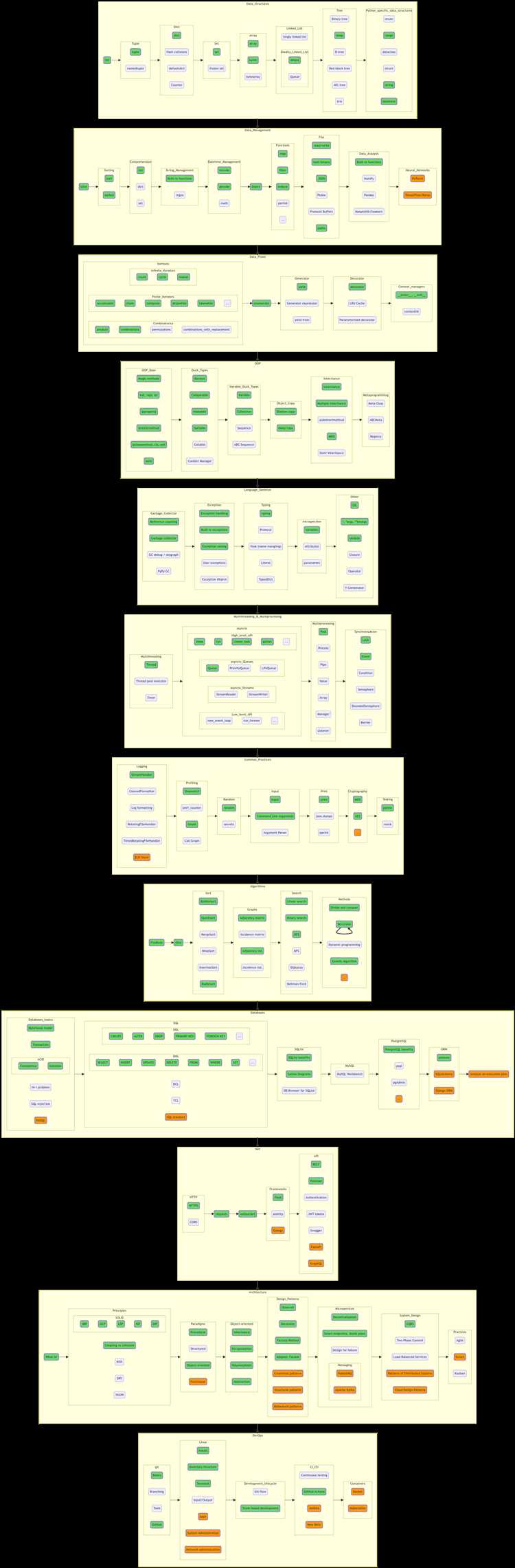

- Поиск причины медленной работы Pandas при объединении больших наборов данных

- Общая проблема медленного объединения данных в Pandas

- Ограничение скорости выполнения операций

- Использование большого объема оперативной памяти

- Возможные причины медленной работы Pandas при объединении данных

- Отсутствие индексов и неоптимальные структуры данных

- Использование неправильных методов объединения данных

- Неэффективное использование параллельных вычислений

- Рекомендации для оптимизации работы Pandas при объединении больших наборов данных

Поиск причины медленной работы Pandas при объединении больших наборов данных

При работе с большими наборами данных в Pandas может возникать проблема с медленной скоростью выполнения операции объединения. Это может привести к значительным задержкам и затруднить анализ данных.

Одной из причин медленной работы Pandas может быть неэффективное использование памяти. При объединении большого количества данных Pandas может потреблять слишком много памяти, что может замедлить работу программы. В таких случаях рекомендуется проверить объем доступной оперативной памяти и увеличить его, если это возможно.

Еще одной причиной медленной работы может быть неправильный выбор способа объединения данных. Pandas предоставляет несколько методов для выполнения операции объединения, таких как merge() и join(). Некоторые методы могут быть более эффективными в определенных сценариях, поэтому рекомендуется изучить документацию Pandas и выбрать подходящий метод для работы с конкретными данными.

Также следует обратить внимание на структуру данных и типы данных, используемые в наборе данных. Некоторые типы данных могут замедлить работу Pandas при выполнении операции объединения. Рекомендуется использовать более эффективные типы данных, если это возможно. Например, использование числовых типов данных вместо строковых может ускорить выполнение операции объединения данных.

Важно также учесть характеристики системы, на которой выполняется код. Некоторые характеристики системы, такие как процессор и скорость доступа к диску, могут значительно влиять на скорость выполнения операции объединения. В случае медленной работы рекомендуется проверить системные характеристики и при необходимости улучшить их.

Общая проблема медленного объединения данных в Pandas

Одна из причин медленного объединения данных в Pandas — это использование циклов для выполнения операций над строками данных. Циклы в Python обычно работают медленно, особенно с большими объемами данных. Таким образом, при использовании циклов для объединения данных, производительность может существенно снижаться.

Еще одна причина медленного объединения данных — это неправильное использование методов Pandas. Некоторые методы, такие как merge() или join(), могут работать медленно, если не использовать правильные параметры или не обрабатывать данные оптимальным образом. Например, при объединении данных, если столбцы не установлены как индексы или нет нужных индексов, методы могут работать медленнее.

Чтобы исправить проблему медленного объединения данных в Pandas, следует использовать рекомендованные методы и стратегии. Например, использование индексов перед объединением может ускорить операцию. Также можно использовать специальные методы Pandas, такие как merge() с определенными параметрами, чтобы улучшить производительность.

Оптимизация производительности объединения данных в Pandas может значительно сократить затраты времени на данную операцию и улучшить общую производительность вашего кода.

Ограничение скорости выполнения операций

Выполнение операций с большими наборами данных может столкнуться с ограничениями скорости в Pandas. В основном это связано с тем, что Pandas предназначен для работы с небольшими и средними наборами данных и может стать неэффективным при обработке больших объемов.

Проблема заключается в том, что Pandas работает в оперативной памяти и пытается загрузить все данные в память одновременно. Это может привести к исчерпанию памяти и замедлению выполнения операций.

Для решения этой проблемы можно использовать несколько подходов:

- Разделение данных на более мелкие фрагменты: если возможно, разделите данные на более мелкие фрагменты и выполните операции отдельно для каждого фрагмента. Это позволит уменьшить нагрузку на память и ускорить выполнение операций.

- Использование инструментов хранения данных: вместо хранения данных в оперативной памяти можно использовать специализированные инструменты хранения данных, такие как Apache Parquet или Apache Arrow. Они позволяют эффективно работать с большими объемами данных и ускоряют выполнение операций.

- Оптимизация операций: при выполнении операций с большими наборами данных можно провести оптимизацию кода. Например, использовать более эффективные функции Pandas или векторизованные операции для минимизации количества обращений к данным.

Несмотря на то, что Pandas может быть медленным при работе с большими наборами данных, существуют способы преодоления этого ограничения. Выбирая подходящий метод и оптимизируя операции, можно значительно улучшить скорость выполнения и обработки больших наборов данных.

Использование большого объема оперативной памяти

В целях оптимизации использования оперативной памяти и повышения производительности при объединении больших наборов данных в Pandas, можно применить следующие подходы:

| Подход | Описание |

|---|---|

| Использование типов данных с меньшим размером | При работе с числовыми данными можно использовать типы данных с меньшим размером, например, int32 вместо int64, чтобы сократить использование оперативной памяти. |

| Использование chunksize при чтении данных | Вместо загрузки всего набора данных в память сразу, можно использовать параметр chunksize при чтении данных из источника, чтобы загружать данные блоками определенного размера и обрабатывать их поэтапно. |

| Использование merge() вместо join() | Функция merge() в Pandas предоставляет более эффективный способ объединения данных, поскольку она может использовать индексы для выполнения объединения, в то время как функция join() всегда выполняет объединение на основе столбцов. |

| Использование внешней памяти | При работе с очень большими наборами данных, которые не удается обработать в оперативной памяти, можно использовать специализированные библиотеки, такие как Dask или Vaex, которые позволяют работать с данными, хранящимися во внешней памяти или даже на диске. |

Применение этих подходов может помочь снизить использование оперативной памяти при объединении больших наборов данных в Pandas и повысить производительность при работе с большими объемами данных.

Возможные причины медленной работы Pandas при объединении данных

При работе с большими наборами данных в Pandas, объединение данных может занимать много времени и ресурсов, что может замедлить работу программы. Возможны несколько причин, которые могут быть ответственными за это:

- Большое количество данных: Чем больше данных нужно объединить, тем больше времени и ресурсов потребуется. Pandas может столкнуться с проблемами производительности при обработке данных, которые не помещаются в память компьютера.

- Неэффективное использование индексов: Использование неоптимальных индексов в наборах данных может замедлить объединение. Например, если индексы не упорядочены или не уникальны, Pandas может тратить время на сортировку данных.

- Неправильное использование методов объединения: Pandas предоставляет различные методы объединения данных, такие как merge() и join(). Неправильное использование этих методов может привести к медленной работе. Например, некорректное указание столбцов для объединения или использование неблагоприятных параметров методов.

- Отсутствие оптимизации операций: В некоторых случаях Pandas может не оптимизировать операции объединения данных, что может замедлить их выполнение. Это может быть вызвано сложными или неэффективными операциями с памятью.

Избежать этих проблем можно, оптимизировав процесс объединения данных. Например, можно разбить большой набор данных на более мелкие части, использовать правильные индексы, выбрать наиболее эффективный метод объединения и провести профилирование кода для определения узких мест производительности. Знание этих причин и применение соответствующих методов оптимизации поможет ускорить работу Pandas при объединении больших наборов данных.

Отсутствие индексов и неоптимальные структуры данных

Вместо этого, рекомендуется создание индексов на основе ключевых столбцов, по которым будет происходить объединение. Использование индексов позволяет значительно ускорить операцию объединения, так как Pandas может использовать эти индексы для создания более эффективных алгоритмов.

Кроме того, выбор подходящих структур данных также может значительно улучшить производительность. Pandas предлагает различные структуры данных, такие как DataFrame и Series, которые можно использовать для хранения и обработки данных. Выбор правильной структуры данных важен для оптимизации операций объединения и работы с большими наборами данных.

Еще одним важным моментом является использование специализированных методов для объединения данных. Например, методы merge() и join() в Pandas предлагают различные параметры и настройки, которые позволяют оптимизировать процесс объединения данных. Использование этих методов с правильными настройками может значительно ускорить операцию объединения и улучшить производительность в целом.

Таким образом, для решения проблемы медленного объединения данных в Pandas для больших наборов данных рекомендуется создание индексов, выбор правильных структур данных и использование специализированных методов. Это поможет улучшить производительность и сократить время выполнения операции объединения.

Использование неправильных методов объединения данных

При работе с большими наборами данных в Pandas важно выбрать правильный метод объединения данных. Неправильный выбор может привести к значительному замедлению работы программы.

Одним из распространенных ошибок является использование метода merge() для объединения данных, когда необходимо выполнить простое соединение двух таблиц. Метод merge() использует сложные алгоритмы сравнения и сопоставления данных, что может быть излишне, если мы знаем, что данные уже отсортированы и соответствуют друг другу.

Вместо этого, для простого объединения таблиц можно использовать метод join() или concat(). Метод join() выполняет объединение по индексу, что может быть намного быстрее, чем сложные алгоритмы merge(). Метод concat() позволяет объединять таблицы по указанной оси, сохраняя исходные индексы и не требуя сложного сопоставления данных.

Выбор правильного метода объединения данных может значительно ускорить работу с большими наборами данных в Pandas. При использовании простого объединения таблиц рекомендуется использовать методы join() или concat() вместо более медленного метода merge().

Неэффективное использование параллельных вычислений

Параллельные вычисления позволяют выполнять несколько задач одновременно, при этом сокращая общее время выполнения программы. Однако, если в случае больших объемов данных не учитывать сложности, связанные с параллельными вычислениями, производительность может быть недостаточной.

При объединении больших наборов данных с помощью Pandas, Python, по умолчанию, не использует параллельные вычисления. Вместо этого, данные обрабатываются последовательно, что может занимать значительное время при работе с большими наборами данных.

Чтобы исправить эту проблему и улучшить производительность, можно использовать параллельные вычисления в Pandas. Одним из способов это сделать является использование параметра «parallel« при вызове функции «merge()« для объединения данных. Установка параметра «parallel« равным «True« позволит Pandas использовать параллельные вычисления и значительно ускорить процесс объединения больших наборов данных.

Однако, необходимо учитывать, что эффективное использование параллельных вычислений требует наличия достаточного количества ядер процессора для распараллеливания вычислений. Если у вас нет многоядерного процессора или если вы работаете с большими объемами данных, использование параллельных вычислений может привести к снижению производительности из-за накладных расходов, связанных с распределением задач на ядра процессора.

Таким образом, для эффективного использования параллельных вычислений в Pandas для объединения больших наборов данных, необходимо учитывать сложности, связанные с параллельными вычислениями, и правильно настроить параметры функции «merge()«. При правильной настройке, использование параллельных вычислений может значительно ускорить процесс объединения данных и повысить производительность.

Рекомендации для оптимизации работы Pandas при объединении больших наборов данных

Объединение больших наборов данных в Pandas может быть долгим процессом, особенно если не применять оптимизационные методы. В этом разделе рассмотрим несколько рекомендаций, которые помогут ускорить работу Pandas при объединении больших данных.

1. Ограничьте объем данных

Если объединение больших наборов данных занимает слишком много времени, попробуйте уменьшить объем данных, выбрав только необходимые столбцы. Используйте функцию DataFrame.loc для выборки нужных столбцов и строк.

2. Используйте промежуточные таблицы

Если объединение происходит несколько раз, то можно сохранить результаты промежуточных объединений в виде отдельных таблиц. Это позволит избежать повторного объединения и сократить время выполнения операций.

3. По возможности используйте метод merge

В Pandas можно использовать разные методы для объединения данных, но в случае больших наборов рекомендуется использовать метод merge. Он является более эффективным и оптимизированным для работы с большими данными.

4. Установите правильный тип данных

Проверьте, что все столбцы в наборах данных имеют правильный тип данных. Например, если используется объединение по столбцу с датой, убедитесь, что этот столбец имеет тип данных даты, а не строки. Правильные типы данных могут ускорить операцию объединения.

5. Используйте индексы

Использование индексов может существенно повысить производительность операции объединения. Убедитесь, что каждая таблица имеет уникальные значения в столбце, который будут использоваться для объединения. Используйте функцию DataFrame.set_index для установки индексов перед объединением.

Соблюдение данных рекомендаций поможет значительно ускорить работу Pandas при объединении больших наборов данных. Оптимизация процесса объединения не только сэкономит время, но и повысит эффективность использования ресурсов компьютера.